4月28日,日日新 SenseNova U1 原生理解生成统一模型发布并开源。沐曦股份(688802)旗下曦云C系列 GPU率先完成 Day 0 适配,成为率先完成该模型适配的国产算力平台。

此次针对SenseNova U1的极速适配,核心依托于沐曦自研MXMACA 软件栈的兼容性与“软硬件一体”计算平台的优化能力。作为沐曦 “自主 GPGPU 硬件 + 全栈软件体系” 的核心枢纽,MXMACA软件栈承担着连接底层算力硬件与上层 AI 应用生态的关键纽带作用。它不仅全链路覆盖底层驱动、用户态接口、MXCC 编译器、算子深度适配、主流训练 / 推理框架对接及行业场景专项优化,兼容支持500+AI模型、4500+开源项目,覆盖95%以上的主流AI场景,还积极拥抱开源。2025年2月,MXMACA软件栈正式开源,至今已积累近50万的生态开发者用户。公司的目标是将MXMACA建设成为人工智能(885728)时代的“Android”(安卓)生态。

截至目前,沐曦股份(688802)已经极速适配业内顶尖模型达21个,全面覆盖DeepSeek、阿里(BABA)千问、百度(K89888)等头部厂商最新旗舰模型,品类涵盖语言、多模态、OCR、文生图、3D 生成等全领域。在国产 GPU Day 0 适配赛道,沐曦股份(688802)持续领跑行业,以 “硬件算力 + 软件生态” 的全栈技术实力,为国产大模型快速迭代与商业化落地筑牢坚实的算力底座。

未来,沐曦股份(688802)将持续深化与国内顶尖 AI 团队的技术协同,依托沐曦自研高性能GPU 与 MXMACA 软件栈的软硬协同优势,加速覆盖更多前沿大模型与创新应用场景,全力构建自主可控、高效繁荣的国产 AI 算力生态。

关于SenseNova-U1

最新发布的日日新SenseNova U1 原生理解生成统一模型,在单一模型架构上统一了多模态理解、推理与生成。它标志着多模态范式一次根本转变:从模态集成走向原生统一。

SenseNova U1模型采用了从底层逻辑自主研发的 NEO-Unify 架构。这是一种从多模态 AI 第一性原理出发设计的全新架构:语言与视觉信息是内在关联的。

NEO-Unify 彻底摒弃了主流的拼接式架构,去除了视觉编码器(Visual Encoder, VE)和变分自编码器(Variational Auto-Encoder, VAE),并以统一表征取而代之,在保留语义丰富性的同时维持像素级视觉保真度。这使得语言与视觉信息能够作为一个统一的复合体被直接建模。

得益于这一全新核心架构,SenseNova U1实现了语言和视觉信息的高效协同,让理解与生成能力同步增强,而非此消彼长,从而实现了极高的多模态学习与建模效率:

理解与生成双维度开源 SoTA:SenseNova U1 为统一多模态理解与生成树立了新的标杆,在理解、推理与生成等广泛基准测试中,取得了开源模型中的 SOTA 水平;而且还做到“以小搏大”,仅凭8B-MoT的较小规格,就能达到甚至超越部分大型商业闭源模型。

原生交错图文思考:SenseNova U1 能够通过单一模型在同一流程中生成连贯交错的文本与图像,支持实用指南、旅行日记等应用场景,将清晰表达与生动叙事相结合,并将复杂信息转化为直观易懂的视觉内容;也能在图像编辑过程中穿插理性思考。

高密度信息呈现:SenseNova U1 展现出强大的密集视觉表达能力,能够生成知识图解、海报、演示文稿、漫画、简历及其他信息密集型内容,将复杂信息浓缩成“一图读懂”。

本次开源发布的是 SenseNova U1 的轻量版系列 SenseNova U1 lite(LITE)。它包含两个不同规格的模型:

SenseNova-U1-8B-MoT:基于稠密骨干网络

SenseNova-U1-A3B-MoT:基于混合专家(MoE) 骨干网络

在图像理解与生成的多项基准测试中,SenseNova U1 lite(LITE)均达到同量级开源模型SOTA水平。尽管体量精炼,但展现出全维度多领域的统治力,甚至在多项指标上直逼大型商业闭源模型。

图像理解基准测试结果

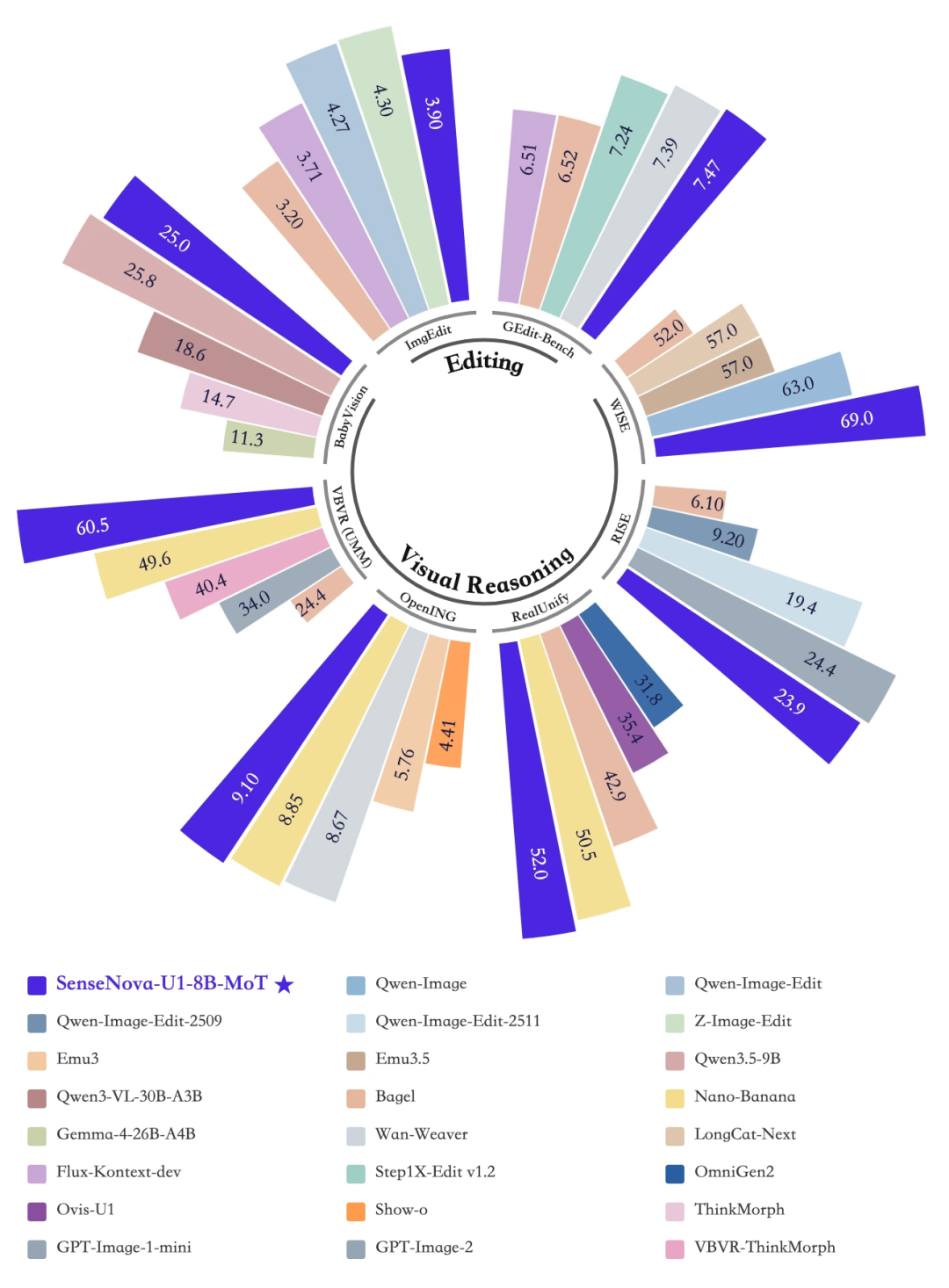

图像生成基准测试结果

视觉推理基准测试结果